前回に引き続き、こちらの本をやっていきます。

基礎からわかる時系列分析 ―Rで実践するカルマンフィルタ・MCMC・粒子フィルター (Data Science Library)

- 作者: 萩原淳一郎,瓜生真也,牧山幸史,石田基広

- 出版社/メーカー: 技術評論社

- 発売日: 2018/03/23

- メディア: 大型本

- この商品を含むブログ (1件) を見る

前回は導入ということで、簡単な分析をなぞってみました。

今回の範囲はこちらです。

前回はとりあえず簡単な時系列分析をやってみるといった位置づけでしたが、今回は状態空間モデルの基本をやってみます。

状態空間モデル

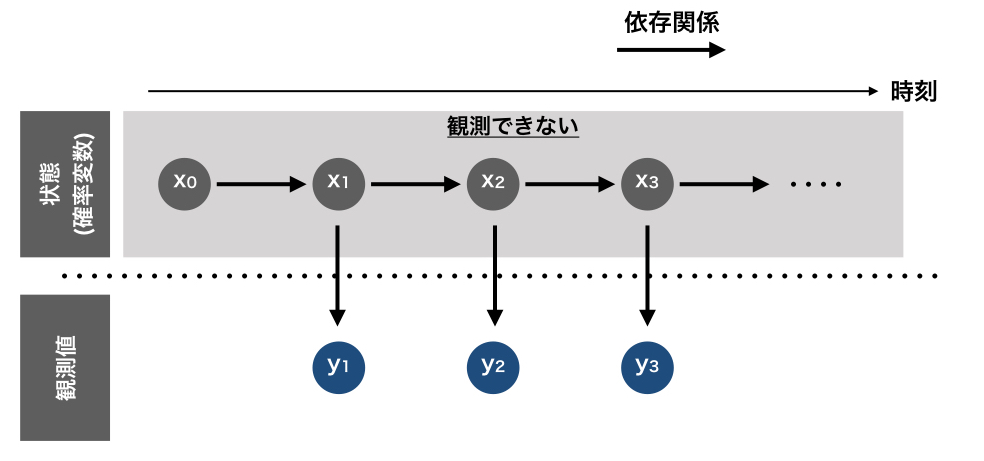

時系列データがどんな関係性にあるかを表現する際に、潜在変数があるかないかで大きく二分されます。 潜在変数を使用するモデルの一つが状態空間モデルで、逆に潜在変数を使用せず観測されるデータの関係性を直接表現するモデルの一つとしてARMAモデルが挙げられます。

状態空間モデルを図で示すと下のようになります。

一方でARMAモデルを図にするとこんなイメージです。

観測されるデータが何に依存しているかが最大の違いとなっています。

この本では状態空間モデルは次のように説明されています。

状態空間モデルは互いに関連のある系列的なデータを確立的に捉えるモデルの1つです。

確率空間モデルでは、直接観測されるデータ(観測値)と直接には観測されない確率変数(状態)を用います。 観測値や状態には、分析を行う上で解釈が容易になるように量を選ぶ必要があります。 そこで、ざっくり言うと下記のような関係性を仮定します。

状態については、状態は前時点のみに依存する(マルコフ性)

観測値については、ある時点の観測値についてはその時点の状態にのみ依存する

これとは対象的に、観測される時系列データだけを見て関係性を求めるモデルをARMAモデルと言ったりします。

状態空間モデルを確率分布で表現すると以下のようになります。

方程式で表すとこんな感じです。

(状態方程式、システム方程式)

(観測方程式)

と

のことを、それぞれ状態雑音(システム雑音)と観測雑音と言います。

ちなみに、図でも確率分布でも方程式でも意味はすべて同じです。

状態の推定

状態空間モデルでの状態を推定することを考えます。

観測値は取得可能ですが、状態は観測不可能です。 そのため、分析に使用する際には、状態を推定することがポイントになります。

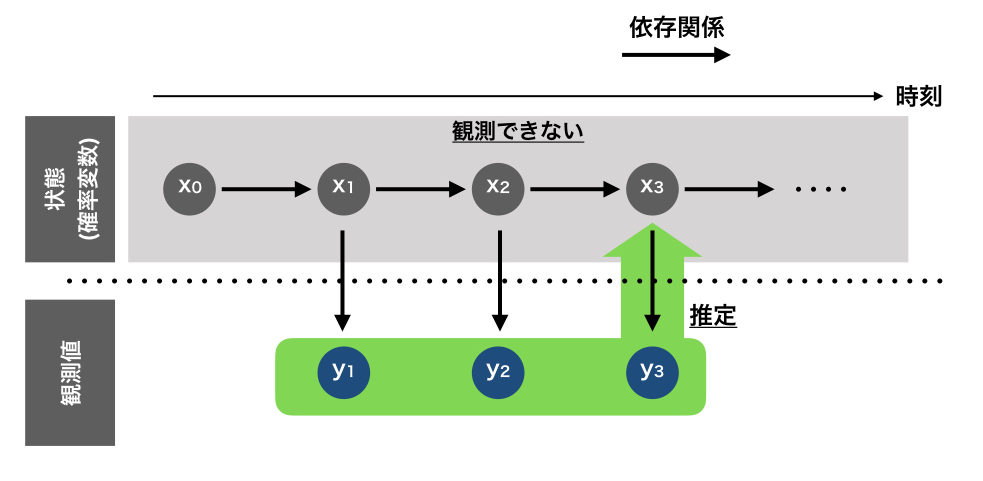

フィルタリング(現在の状態の推定)

フィルタリングは過去から現在まで観測された時系列データを使用して、現在の状態を推定します。

- input : 観測された時系列データ

- output : 現在の状態

イメージにするとこんな感じです。

見方を変えるとこんな感じで表現されます。

これは右方向が潜在変数の時間進行、下方向が観測値の時間進行を表しています。 実際には同じ時間軸に乗っているので、右下の方向に向かって進んでいきます。

フィルタリング分布について細かい数式はおいておいて、結論だけ書くと、

フィルタリング分布:

一期先予測分布:

一期先予測尤度:

となります。(証明は端折ります。本買って読んでください。)

簡単にまとめると、

フィルタリングでは時刻0の状態から始まり、

- 潜在変数が時間進行

- 潜在変数の変化に伴い観測値が変化

を繰り返していきます。イメージとしてはこんな感じです。

このようにフィルタリングでは階段状に、現在の観測値から潜在変数を推定していきます。

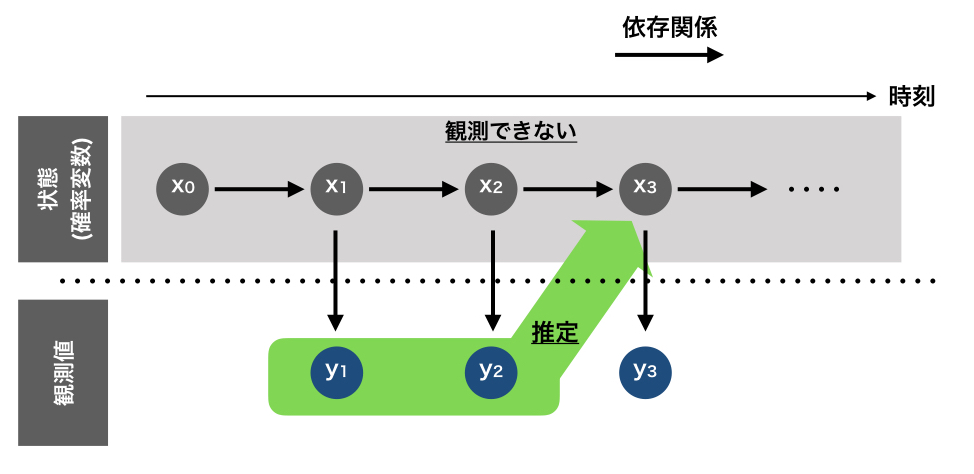

予測(未来の状態を推定する)

次に未来の観測値について考えます。 未来なので観測値は手にはいりません。

この場合は、手に入っている現在の観測値から潜在変数を求めていきます。(証明は端折ります。本買って読んでください。)

予測分布:

イメージはこんな感じで潜在変数だけ時間進行するイメージで潜在変数を推定します。

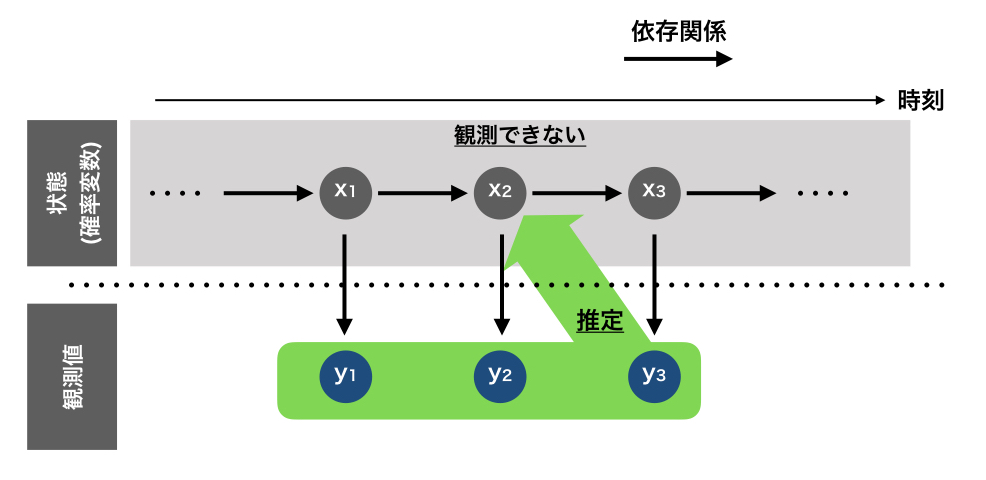

平滑化(過去の状態を推定する)

今度は現在より過去の状態を推定することを考えます。

一旦時刻T(>t)までフィルタリングが完了している状態から考えます。 平滑化分布は下記のように表現されます。(証明は端折ります。本買って読んでください。)

平滑化分布:

これにより過去に遡って潜在変数を推定します。

一括解法

ここからは実際に潜在変数を求めてみます。 まずは過去から知りたい時点までの状態を一括で求める一括解法についてです。

定常な状態時系列(平均・分散・自己共分散・自己相関係数が時間によって変化しない)に対して適用できるウィナーフィルタを見ていきます。

ウィナーフィルタ

下のような観測値と推定値の関係を考えます。

そして、観測値から状態を推定する逆変換を下のように考えます。

ここで、

となっています。(※は畳み込みを表す)

さて、モデルがなんとなくわかったところで、まずは答えとなる状態と観測値を作ります。

状態は一つ前の状態とノイズw、観測値は状態とノイズvに依存していますね。

この逆変換(ウィナー平滑化)はこんな感じになります。

Σ(゚Д゚)

もはや数学っすね。詳しくはよくわかんないですが、スペクトル変換をして周波数成分に一回落としてからもう一度足し込むみたいです。←適当

これをRで書くとこんな感じになるらしいです。

gist8e32abba01868303601d6ba7cd17c89f

スッキリしてますねー。

こんな感じで観測値から状態を一括推定できました。

感想

難しいところを思い切りすっ飛ばしたのですが、それでも難しいです。 カルマンフィルタに行き着く前に力尽きました。。。